AI技术的快速发展让越来越多的人希望能够训练自己的AI模型,然而,这一过程需要强大的算力支持,而显卡作为核心硬件,直接决定了训练与推理的效率。面对众多显卡选择,本文将根据预算与需求,为您推荐适合AI训练的显卡。

一、选购注意事项

显存容量 > 核心频率:模型参数越大,对显存的需求越高。如,运行Stable Diffusion XL至少需要8GB显存,训练百亿参数模型则建议24GB起步。

软件兼容性:NVIDIA显卡支持CUDA,主流框架如PyTorch、TensorFlow对其优化更为完善。AMD显卡则依赖ROCm平台,部分功能可能受限。

功耗与散热:高性能显卡如RTX 4090满载功耗高达450W,因此需要搭配850W以上的电源,并且多卡并联时,优选涡轮散热设计的显卡。

二、入门级

NVIDIA RTX 3060 12GB

优点:12GB显存,支持CUDA加速,适合运行Stable Diffusion等主流AI绘画模型,价格在2000-2500元左右。

适用场景:AI对话机器人、小规模图像生成、机器学习课程等。

AMD Radeon RX 6600 XT 8GB

优点:价格更低(1500-1800元),支持ROCm开源平台,适合预算有限且愿意使用开源工具的用户。

注意:部分AI框架对AMD显卡支持较弱,需确认兼容性。

三、主流级

NVIDIA RTX 4070 12GB

优点:支持DLSS 3技术,12GB显存,适合运行Llama 2-7B等中型语言模型,功耗仅200W,售价约4500元。

适用场景:多任务AI推理、本地私有化AI服务部署。

NVIDIA RTX 4080 16GB

优点:9728个CUDA核心,16GB显存,适合训练中型模型,显存带宽高达716GB/s,售价约8000元。

性价比:相比专业级显卡(如A100),价格仅为1/5,适合中小型企业开发AI原型。

四、专业级

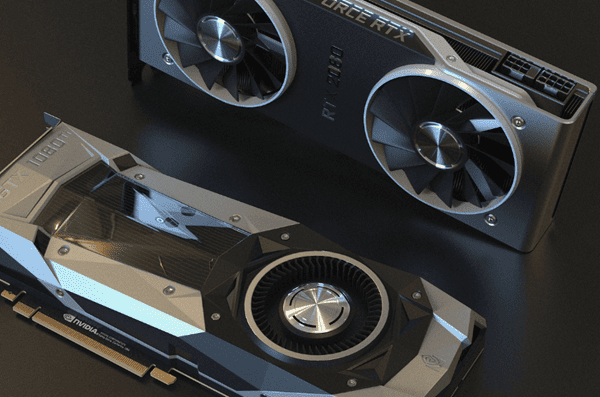

NVIDIA RTX 4090 24GB

优点:16384个CUDA核心,24GB显存,适合微调GPT-3等百亿参数模型,支持NVLink多卡并联,售价约13000元。

适用场景:大型模型训练与高性能AI任务。

NVIDIA A100/H100

优点:专为分布式训练优化,显存高达40-80GB,适合大规模AI计算,售价较高。

适用场景:企业级AI训练。

五、优化显卡性能

在进行AI项目的前期准备时,不要忘了保持系统和显卡驱动的最新状态,避免性能下降或兼容性问题。可以使用“驱动人生”软件,它帮助自动检测并更新显卡驱动,确保AI任务顺利进行。

只需下载并启动该软件,点击“立即扫描”功能,便能轻松找到并更新驱动程序。

希望通过本文的推荐,你能找到最适合自己需求的显卡,为你的AI之路助力。